AI Act Update für Startups

Key Takeaways der vergangenen Termine

Das Wichtigste in Kürze

Wichtige Anforderungen pro Risikokategorie: Minimal- und begrenztes Risiko: keine bis geringe Verpflichtungen, z.B. Transparenzpflichten; hohes Risiko: Details zu wichtigen Anforderungen; inakzeptables Risiko: bestimme KI-Anwendungen sind verboten

Minimal- und begrenztes Risiko:

Diese Kategorisierung umfasst KI-Systeme, die keine oder nur sehr geringe Risiken für die Gesellschaft oder die Rechte von Personen darstellen. Diese Systeme unterliegen nur geringen Verpflichtungen, vor allem Transparenzpflichten. Ein Beispiel wäre eine KI, die einfache Aufgaben wie die Empfehlung von Filmen übernimmt. Um unnötige Bürokratie zu vermeiden und die Entwicklung von KI zu fördern, die keine signifikanten Risiken darstellt.

Hohes Risiko:

Diese KI-Systeme können erhebliche Auswirkungen auf die Sicherheit und grundlegende Rechte der Nutzer haben. Sie werden in zwei Hauptkategorien unterteilt:

- Kombination mit Produktvorschriften (z.B. KI in Medizinprodukten, Flugzeugen, Autos)

- KI in kritischen Bereichen (z.B. Gesundheitswesen, Bildung, Justiz, Migration, Polizei)

Diese Systeme müssen registriert und geprüft werden, bevor sie auf den Markt kommen. Sie unterliegen umfangreichen Anforderungen bezüglich Datensicherheit, Dokumentation und regelmäßiger Überprüfung.

Um sicherzustellen, dass die KI in sicherheitskritischen Bereichen keine negativen Auswirkungen auf den Einzelnen oder die Gesellschaft hat.

Inakzeptables Risiko:

Diese KI-Systeme stellen eine unmittelbare Bedrohung für die Sicherheit oder die Grundrechte von Personen dar. Dazu gehören beispielsweise:

- Kognitive Manipulation (z. B. KI, die das Verhalten von Kindern oder anderen besonders schutzbedürftigen Gruppen beeinflusst)

- Gesichtserkennung in Echtzeit (z. B. für die Überwachung auf öffentlichen Plätzen)

- Soziale Punktesysteme (z. B. die Bewertung von Menschen basierend auf ihrem Verhalten oder sozioökonomischen Status)

Diese Systeme werden verboten, es sei denn, es gibt spezifische Ausnahmen (z. B. für Strafverfolgungsbehörden in sehr begrenztem Umfang). Der Schutz der Privatsphäre, der Grundrechte und der Freiheit der Menschen ist hier oberste Priorität.

Generative KI unterliegt speziellen Transparenzpflichten:

- Offenlegung: Nutzer müssen darüber informiert werden, dass der Inhalt von einer KI generiert wurde.

- Urheberrecht: Die KI muss so gestaltet sein, dass sie keine illegalen Inhalte erzeugt.

- Training: Es muss transparent gemacht werden, welche Daten zum Trainieren der KI verwendet wurden.

Relevanz und Sonderregelungen für Startups

- Es gibt keine generelle Ausnahme für Startups!

- Aber: Eine Reihe einzelner Ausnahmen und Sonderregelungen

- Vorrangiger und kostenloser Zugang zu KI-Reallaboren (Art. 57, 62, ErwG 143)

- Förderung der Beteiligung an technischer Normung (Art. 62, ErwG 143)

- Berücksichtigung der besonderen Bedürfnisse bei der Festlegung von Gebühren im

Konformitätsbewertungsverfahren (Art. 62, ErwG 143)

- Vereinfachung der Dokumentation und Kommunikation (Art. 11, 62 ErwG 143)

- Eine Sprache, standardisierte Vorlagen etc.

- Bereitstellung einer Informationsplattform durch das AI Office und Sensibilisierungs- und Schulungsmaßnahmen durch die MS (Art. 62)

Weitere Sonderregelungen für Startups:

- Berücksichtigung „besonderer Bedürfnisse“ von Startups bei der Erarbeitung von Leitlinien

durch die EU-Kommission (Art. 96) - Berücksichtigung der besonderen Umstände des Einzelfalls bei der Bemessung von Geldbußen (Art. 99, ErwG 168)

- Für Kleinstunternehmen: Vereinfachtes Qualitätsmanagementsystem (Art. 63)

- Kleinstunternehmen < 10 MA, < 2 Mio Jahresumsatz

- Startups werden im Beratungsforum (Advisory Forum) repräsentiert (Art. 67, ErwG 150)

- Berät die EU-Kommission und das KI-Gremium (AI Board) bei deren Aufgaben

Stand der Nationalen Umsetzung

30.01.2025 mit Evelyn Grass, Referatsleiterin für Künstliche Intelligenz im BMWK

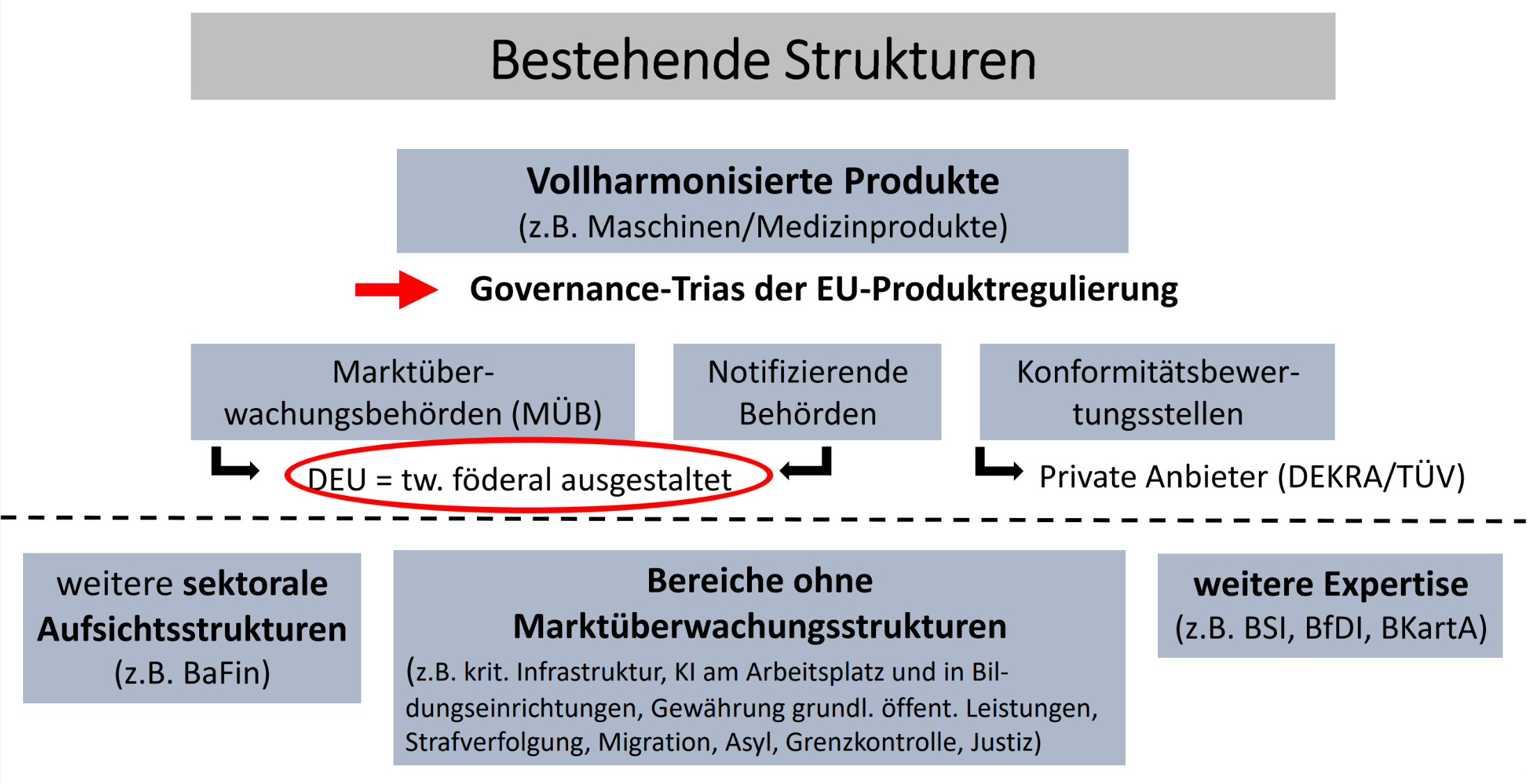

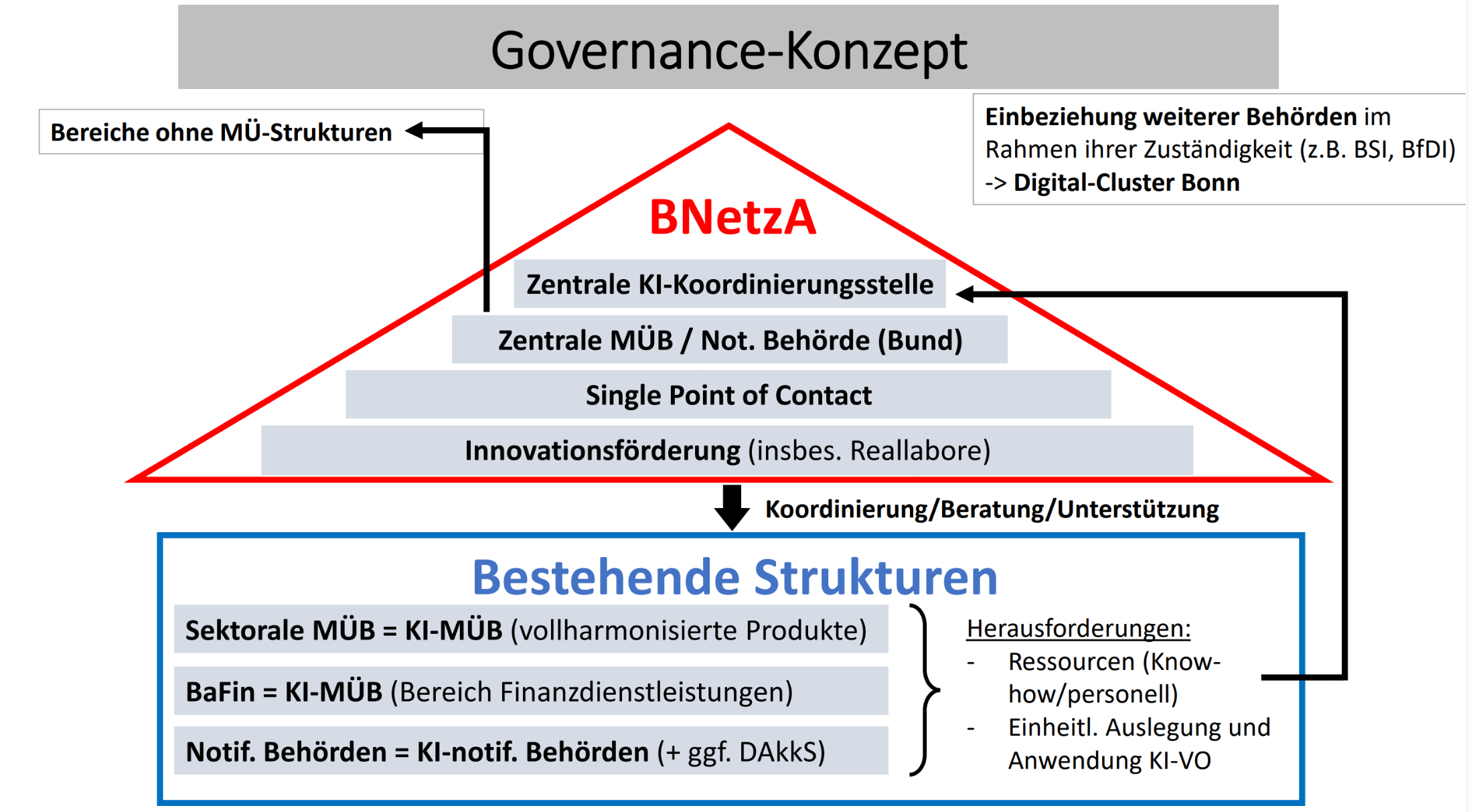

Die Europäische Union hat mit der KI-Verordnung (KI-VO) einen rechtlichen Rahmen für den Einsatz Künstlicher Intelligenz geschaffen. Zur nationalen Umsetzung dieses Regelwerks wird ein strukturiertes KI-Governance-Konzept entwickelt, das eine effiziente Aufsichtsstruktur sowie innovationsfreundliche Rahmenbedingungen gewährleisten soll. Die Federführung obliegt dem Bundesministerium für Wirtschaft und Klimaschutz sowie dem Bundesministerium der Justiz.

Zudem befindet sich aktuell ein Referentenentwurf zur nationalen Umsetzung der KI-VO in Regierungskonsultation. Hierbei ist zu beachten, dass die Wahl am 23. Februar bevorsteht und ein abschließender Beschluss vorher als nicht realistisch gilt. Einige Verbote treten jedoch bereits zuvor in Kraft. Es bleiben daher viele Fragen offen, die wir in folgenden Sitzungen des AI Act Updates genauer mit Euch beleuchten möchten.

Kernbereiche des Governance-Konzepts von BMJ und BMWK:

Festlegung der nationalen Behörden- und Aufsichtsstruktur: Definition der zuständigen nationalen Institutionen und ihrer Aufgaben.

Sanktionen: Mechanismen zur Durchsetzung und Ahndung von Verstoßen gegen die KI-VO.

Einrichtung mindestens eines KI-Reallabors: Testumgebung für innovative KI-Technologien und regulatorische Erprobungen.

Datenbank für KI-Systeme im Bereich kritischer Infrastrukturen: Erfassung und Überwachung sicherheitsrelevanter KI-Anwendungen.

Darüber hinaus: Europäische Dimension der KI-Governance

AI Board: Koordinierung der Umsetzung und Durchsetzung der KI-VO.

AI Office: Operative Steuerung der Regulierung von General-Purpose-AI (GPAI)-Modellen.

Scientific Panel: Wissenschaftliche Beratung zu regulatorischen und technologischen Fragestellungen.

Advisory Forum: Beteiligung von Stakeholdern aus Industrie, Zivilgesellschaft und Wissenschaft.

Nationale Umsetzung und Verzahnung mit EU-Rechtsakten

Die nationale Umsetzung der KI-VO soll unter Beachtung weiterer relevanter EU-Rechtsakte wie dem Digital Services Act, Data Act und Data Governance Act vorgenommen werden mit dem Ziel, schlanke Strukturen zu schaffen, Doppelstrukturen zu vermeiden und Aufsichtsaufgaben effizient zu bündeln.

Herausforderungen:

Bereitstellung von Fachkräften mit KI- und Regulierungswissen.

Einheitliche Auslegung und Anwendung der KI-VO zur Vermeidung von Rechtsunsicherheiten.

Bereitstellung finanzieller Mittel für Aufsichts- und Zertifizierungsprozesse.

Brüssel bleibt Antworten zum Teil schuldig, bisher keine Leitlinien trotz nahender Deadline

Wahl am 23. Februar sorgt für weitere Unsicherheit