Künstliche Intelligenz

Der AI Act

Der AI Act ist die erste umfassende gesetzliche Regelung für Künstliche Intelligenz (KI) auf EU-Ebene. Ziel des Rechtsakts ist es, ein einheitliches Regelwerk zu schaffen, das Innovation fördert, gleichzeitig aber Risiken durch den Einsatz von KI minimiert und Grundrechte schützt. Der AI Act verfolgt dabei einen risikobasierten Ansatz: Je höher das Risiko, das von einer KI-Anwendung ausgeht, desto strenger die Anforderungen. Er unterscheidet zwischen verbotenen, hochriskanten, risikoarmen und minimal riskanten KI-Systemen. Hochrisiko-KI, etwa in Bereichen wie kritischer Infrastruktur, Bildung, Beschäftigung oder Strafverfolgung, unterliegt umfangreichen Vorgaben zur Transparenz und Verlässlichkeit. Der AI Act regelt zudem erstmals sogenannte General Purpose AI (GPAI), also KI-Modelle mit allgemeinem Verwendungszweck.

Normen unter dem AI Act

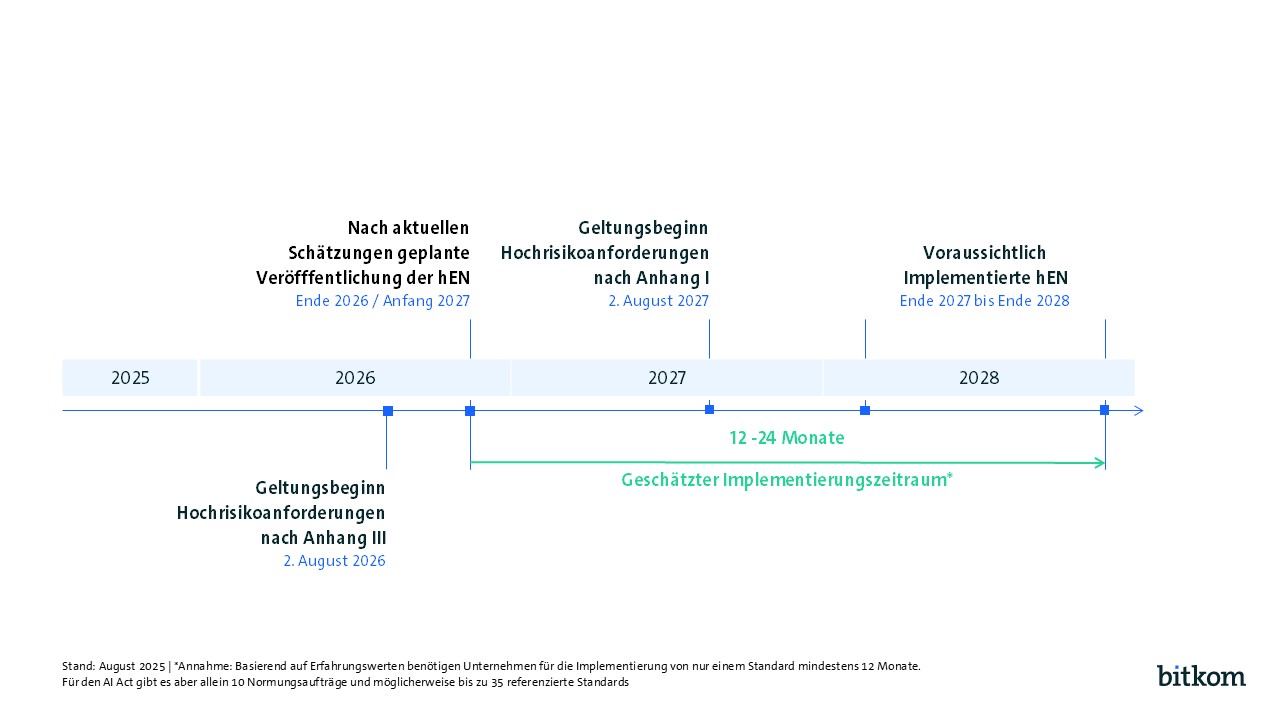

Speziell für die technische Ausgestaltung der Anforderungen an Hochrisiko-KI-Systeme hat die EU-Kommission bereits im Mai 2023 einen Normungsauftrag zur Erarbeitung harmonisierter europäischer Normen (hEN) an die europäischen Standardisierungsorganisationen CEN/CENELEC erteilt. Das gemeinsam zuständige Gremium für KI – JTC 21 – erarbeitet diese Normen derzeit mithilfe der nationalen Spiegelgremien, in Deutschland vertreten durch das DIN. Der Erarbeitungsprozess der hEN verzögert sich allerdings bislang erheblich, und es ist aktuell nicht davon auszugehen, dass die hEN rechtzeitig vor Geltungsbeginn der Anforderungen für Hochrisiko-KI-Systeme gemäß Anhang III zur Verfügung stehen werden.

Timeline AI Act

Einblick in relevante Normen

Während harmonisierte Normen* zur Unterstützung des AI Acts noch erarbeitet werden, können Sie bereits veröffentlichte Normen verwenden, um vertrauenswürdige KI zu entwickeln, auch wenn sie keine Konformitätsvermutung bieten:

- ISO/IEC 42001 bietet ein Managementsystem für KI

- ISO/IEC 23894 bietet einen Risikorahmen

- ISO/IEC 22989 gibt eine gemeinsame Sprache (Terminologie) an die Hand

- ISO/IEC 23053 bildet den Lebenszyklus ab (KI-Ökosystem)

- ISO/IEC 24368 befasst sich mit Ethik und menschlichen Auswirkungen

- ISO/IEC 24028 schafft einen konzeptionellen Rahmen für Vertrauenswürdigkeit von KI

- ISO/IEC 38507 konzentriert sich auf KI-Governance

- CEN/CLC 17894 gibt Hinweise zur Konformitätsbewertung

- CEN/CLC 18115 befasst sich mit Datenmanagement und -qualität

- ISO/IEC 27001 bietet ein Informationssicherheits-Managementsystem (ISMS)

Mehr Informationen und Zugriff auf die Normen erhalten Sie bei DIN, DKE und ETSI.